Wer wirklich zahlt – wie die KI-Industrie das Internet und unsere Gesellschaft bedroht:

Millionen unsichtbarer Hände: Datenarbeit für die KI

Die schönen neuen KI-Welten, in denen Texte, Bilder und Videos auf Knopfdruck entstehen, haben eine unsichtbare Grundlage: Millionen von Menschen, die weltweit als Datenarbeiter beschäftigt sind. Laut Schätzungen der Weltbank gibt es zwischen 150 und 430 Millionen Menschen, die zumindest gelegentlich sogenannte „Mikroarbeit“ erledigen – also kurze digitale Aufgaben. Viele davon arbeiten direkt oder indirekt am Training von KI-Systemen.

Eine realistische Zahl für jene, die regelmäßig an KI-Annotationen beteiligt sind, liegt wahrscheinlich im zweistelligen Millionenbereich – etwa 10 bis 20 Millionen Menschen weltweit. Sie sitzen in Indien, auf den Philippinen, in Venezuela oder in Kenia. Plattformen wie Appen, Clickworker, Scale AI oder Amazon Mechanical Turk vermitteln diese Jobs.

Ein bekannt gewordenes Beispiel ist Sama in Nairobi, Kenia: Hunderte Menschen klassifizierten für weniger als 2 Dollar pro Stunde Texte mit extrem verstörenden Inhalten, um ChatGPT „toxische“ Sprache abzutrainieren. Arbeiter bekamen extrem belastende Texte zu sehen: Gewaltfantasien, Kinderpornografie-Beschreibungen und Folterszenarien. Ihre Aufgabe war es, Inhalte in Kategorien einzuordnen wie „Sexueller Missbrauch“, „Hassrede“ oder „Selbstverletzung“. Für viele war es ein Job ohne Sicherheit, ohne psychologische Betreuung, mit extrem belastenden Auswirkungen. Manche sprachen von „Traumatisierung am Fließband“. Das klingt pervers: Um die Künstliche „Intelligenz“ überhaupt nutzbar zu machen, werden massenhaft unterbezahlte Arbeiter:innen traumatisiert?

Wie KI wirklich trainiert wird

Die Entwicklung von KI ist nicht magisch, sondern ein aufwändiger und arbeitsintensiver Prozess:

- Datensammlung: Milliarden Texte, Bilder und Videos werden aus dem Internet gesaugt oder gezielt eingekauft.

- Annotation durch Menschen: Crowdworker markieren, ob Inhalte beleidigend, informativ, korrekt oder irrelevant sind.

- Vortrainierung: Das Modell lernt statistische Muster auf gewaltigen Datenmengen.

- Feintuning: Mit Methoden wie „Reinforcement Learning from Human Feedback“ (RLHF) bewerten Menschen Antworten des Modells und geben Korrekturen vor.

- Evaluation: Auch hier sind wieder Menschen im Einsatz, die prüfen, wie „gut“ das System arbeitet.

Ohne diese menschliche Vorarbeit wären heutige Sprach- oder Bildmodelle schlicht nicht funktionsfähig. Diese Tatsache verdeutlicht, die dem Begriff künstliche „Intelligenz“ innewohnende Täuschung.

Der ökologische Preis: Energie und Wasser

Neben der menschlichen Arbeitskraft ist es vor allem die Energiefrage, die nachdenklich stimmt.

- Das Training von GPT-3 soll etwa 1,3 Gigawattstunden Strom benötigt haben – genug, um über 100 US-Haushalte ein Jahr lang zu versorgen.

- GPT-4 dürfte noch weitaus mehr verbraucht haben, Schätzungen sprechen von mehreren Gigawattstunden.

- Datenzentren verschlingen zusätzlich enorme Mengen an Wasser: Microsoft gab 2023 bekannt, dass der Wasserverbrauch seiner Rechenzentren um 34 % gestiegen ist – unter anderem durch KI-Anwendungen.

Der CO₂-Ausstoß eines einzigen großen Modells kann leicht mehrere hundert Tonnen erreichen, vergleichbar mit hunderten Transatlantikflügen.

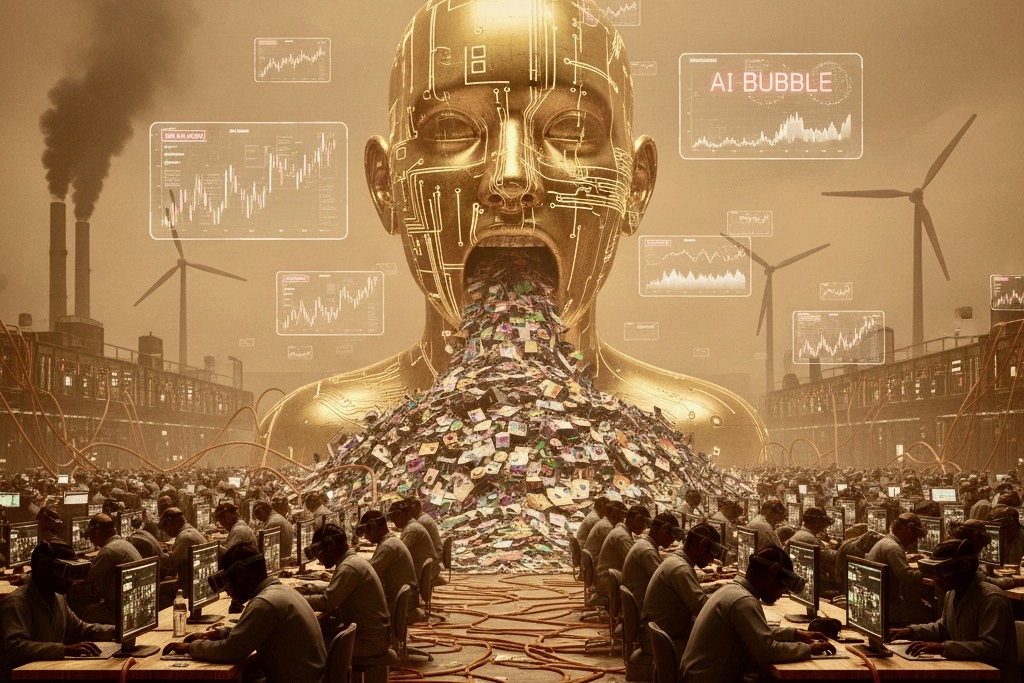

Der Slop-Kreislauf: Wie Content verdirbt

Wenn die Modelle einmal im Einsatz sind, beginnt der nächste problematische Prozess: der Slop-Kreislauf.

- KI-Tools erzeugen massenhaft Content: Blogartikel, SEO-Texte, Produktbeschreibungen, Fake-Rezensionen.

- Zunehmend kommen auch Deepfakes hinzu – manipulierte Bilder, Stimmen und Videos, die täuschend echt wirken.

- Plattform-Algorithmen wie die von Google, TikTok oder Meta belohnen Masse und Reichweite, nicht Qualität. Sie verstärken also genau jenen billigen KI-Content, der Klicks bringt.

- Hochwertige Inhalte von echten Autor:innen, Journalist:innen oder Künstler:innen geraten ins Hintertreffen, weil sie in der Flut untergehen oder vom Algorithmus schlechter ausgespielt werden.

- Neue KI-Systeme greifen dann wieder auf diese Daten zurück – und trainieren zunehmend auf KI-generiertem Müll.

So entsteht ein Degenerationskreislauf: KI produziert Slop, dieser Slop wird von Plattformen verstärkt, verdrängt gute Inhalte und füttert am Ende wieder die nächste KI-Generation.

Die Folge:

- Autor:innen und Künstler:innen verlieren Reichweite und Einkommen, weil ihre Werke im Datenrauschen untergehen oder von KI-Plagiaten kopiert werden.

- Kulturelle Vielfalt und kritische Stimmen werden geschwächt.

- Das Internet verkommt von einem Raum menschlicher Kreativität zu einer Müllhalde automatisierter Beliebigkeit.

Finanzblase und Superintelligenz-Hype

Parallel dazu erleben wir eine Spekulationswelle an den Finanzmärkten. Nvidia ist 2025 das wertvollste börsennotierte Unternehmen der Welt, während Start-ups mit Milliarden bewertet werden, ohne tragfähiges Geschäftsmodell. Viele Ökonom:innen warnen vor einer KI-Blase, vergleichbar mit der Dotcom-Euphorie um 2000.

Dazu kommt die Erzählung von der baldigen AGI (Artificial General Intelligence) oder gar ASI (Artificial Superintelligence). Schon in den 1950er Jahren sagte der Informatiker I.J. Good voraus, dass bald eine „intelligence explosion“ eintreten werde, bei der Maschinen alle Probleme lösen. Seitdem wiederholt sich die Geschichte: In den 1970ern, 1980ern, 2000ern und heute – stets hieß es, die Superintelligenz stehe vor der Tür.

Doch bis heute sind wir weit davon entfernt. Kritische Stimmen machen das deutlich:

- Rodney Brooks (MIT): „Wir verwechseln Demos mit Intelligenz.“ KI sei weit von menschlicher Flexibilität entfernt.

- Gary Marcus (NYU): „Deep Learning allein reicht nicht. Ohne Kausalität und Commonsense bleibt AGI Illusion.“

- Emily Bender (University of Washington): Sprachmodelle sind „stochastische Papageien“ – sie verstehen nicht, was sie sagen.

- Abeba Birhane (ETH Zürich): AGI-Hype ist ein „koloniales Narrativ“, das Ausbeutung im Globalen Süden verschleiert.

- Yann LeCun (Meta AI): „Niemand weiß, wie man AGI baut. Wir sind nicht nah dran.“

Die Erzählung von der Superintelligenz dient oft weniger der Wissenschaft als dem Marketing und der Kapitalbeschaffung.

Fortschritt – oder Scheinfortschritt?

Die Frage ist daher: Können wir das wirklich Fortschritt nennen?

- Millionen Datenarbeiter schuften für Centbeträge und sehen traumatisierenden Content.

- Das Klima wird durch den Energiehunger der Modelle belastet.

- Das Internet droht im Slop zu ersticken.

- Finanzblasen und Mythen von Superintelligenz verschieben Aufmerksamkeit und Kapital.

Wenn Fortschritt bedeutet, die Lebensqualität zu erhöhen, Ungleichheit zu verringern und die Umwelt zu schützen, dann ist das, was wir derzeit erleben, eher Scheinfortschritt.

Was wir tun könnten

Gibt es Wege, gegenzusteuern? Gibt es politische, wirtschaftliche und gesellschaftliche Hebel? Darüber sollten wir dringend nachdenken. Eine kurze Liste zentraler Ansätze:

- Transparenz: KI-Firmen müssen offenlegen, welche Daten sie nutzen und wie viel Energie sie verbrauchen.

- Faire Arbeit: Mindeststandards, gerechte Bezahlung, psychologische Betreuung für Crowdworker.

- Urheberrechte: Künstler:innen müssen ein Opt-out haben und für die Nutzung ihrer Werke entschädigt werden.

- Ökologische Regeln: Rechenzentren verpflichten, auf erneuerbare Energien und effiziente Kühlung zu setzen.

- Kennzeichnungspflicht: KI-generierte Inhalte müssen klar erkennbar sein.

- Gemeinwohl-KI: Öffentliche Investitionen in KI für Medizin, Bildung und Klimaforschung – statt reiner Profitorientierung.

- Wettbewerbspolitik: Maßnahmen gegen Monopole, Förderung offener Modelle.

Fazit

Technisch und oberflächlich wirkt KI beeindruckend. Aber Fortschritt misst sich nicht an Rechenleistung, sondern daran, ob sie das Leben der Menschen verbessert. Bisher sehen wir vor allem Kosten: menschliche, ökologische und kulturelle.

Echter Fortschritt entstünde erst, wenn KI fair, nachhaltig und gemeinwohlorientiert entwickelt wird. Nicht als Werkzeug für die Machtkonzentration weniger Konzerne, sondern als Technologie, die die Lebensqualität aller steigert.

Quellen- und Literaturliste

Dokumentarfilme / Medien

- Arte-Doku: KI: Der Tod des Internets (Regie: Mario Sixtus, 2024).

- Arte-Doku: KI – Die letzte Erfindung? (Arte, 2024).

Journalistische Quellen

- Perrigo, Billy: OpenAI Used Kenyan Workers on Less Than $2 Per Hour to Make ChatGPT Less Toxic. TIME Magazine, 18.01.2023.

👉 time.com

- Perrigo, Billy: AI Gig Workers Face ‘Unfair Working Conditions,’ Study Says. TIME Magazine, 2023.

- The Guardian: ‘It’s destroyed me completely’: The human cost of training AI. 02.08.2023.

- VICE: OpenAI Used Kenyan Workers Making $2 an Hour to Filter Traumatic Content From ChatGPT. 2023.

- CBS News / 60 Minutes: The hidden costs of AI: Underpaid Kenyan workers and the toll of content moderation. 2023.

- Economist: The Hidden Workforce Behind AI. 10.04.2025.

- WeeTracker: OpenAI Paid Sama $12 an Hour Per Worker—Kenyans Only Got $2. 25.11.2024.

Wissenschaftliche Arbeiten

- Bender, Emily M.; Gebru, Timnit; McMillan-Major, Angelina; Mitchell, Margaret:

On the Dangers of Stochastic Parrots: Can Language Models Be Too Big? In: Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency (FAccT ’21). Association for Computing Machinery, 2021. DOI: 10.1145/3442188.3445922 - Marcus, Gary: Deep Learning Is Hitting a Wall. Substack / garymarcus.substack.com, 2022.

- Crawford, Kate: Atlas of AI: Power, Politics, and the Planetary Costs of Artificial Intelligence. Yale University Press, 2021.

- Birhane, Abeba: Algorithmic Colonization of Africa. SCRIPTed, Vol. 17, No. 2, 2020. DOI: 10.2966/scrip.170220.389

- Brooks, Rodney: The Seven Deadly Sins of AI Predictions. MIT Technology Review, 2017.

- Chomsky, Noam; Roberts, Ian; Watumull, Jeffrey: The False Promise of ChatGPT. The New York Times, 08.03.2023.

Studien und Reports

- Weltbank: The Global Gig Economy. Washington, 2021.

- Fairwork Project: Fairwork Cloudwork Report. Oxford Internet Institute, 2023.

- International Labour Organization (ILO): World Employment and Social Outlook 2021 – The role of digital labour platforms in transforming the world of work. Genf, 2021.

Online-Dossiers

- Privacy International: Humans in the AI Loop – The Data Labelers Behind Some of the Most Powerful LLMs. 2023.

- AlgorithmWatch: AI and the Hidden Human Labour Behind It. 2022.

Schreibe einen Kommentar

Du musst angemeldet sein, um einen Kommentar abzugeben.